Теперь компьютеры способны понимать жесты

Теперь компьютеры способны понимать жесты.

Теперь компьютеры способны понимать жесты.

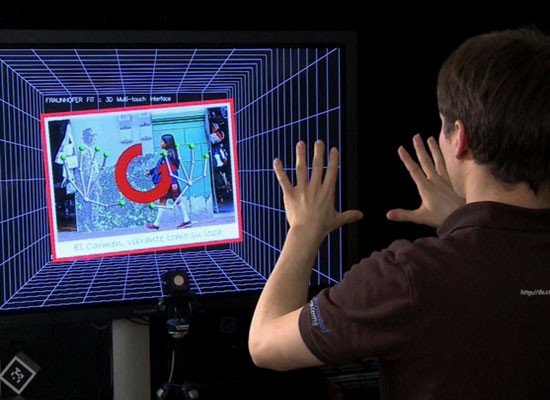

Учёные всего мира давно работают над системами, позволяющими отказаться от компьютерной мыши. Одним из таких разработчиков является и аспирант МФТИ Алексей Куракин, который разработал новый метод ввода данных в компьютер, используя для этого web-камеру и собственные руки.

Для того, чтобы компьютер считывал ваши жесты не потребуется никакого специального оборудования, достаточно ноутбука, штатива и Web-камеры.

Как рассказывает автор разработки: «Перемещать объект в трёхмерном пространстве рукой просто, т.к. ней можно двигать в шести направлениях, а мышь позволяет перемещать курсор только в двух».

Разработанный алгоритм выстраивает модель кисти и по количеству видимых пальцев определяет, какое действие нужно произвести. Данный алгоритм позволяет поворачивать, перемещать и растягивать изображение. Установка же второй Web-камеры позволит работать с трёхмерными моделями.

Для того, чтобы алгоритм точно отслеживал движение рук во всех трёх измерениях учёным пришлось имитировать бинокуляное зрение, т.е. использовать вторую Web-камеру, располагая её на некотором расстоянии от первой. Бинокулярное зрение позволяет программе фиксировать положение контрольных точек, т.е. отслеживать их перемещение. В качестве таких контрольных точек выступают ладони и кончики пальцев. Таким образом, совмещая изображения, получаемые с двух камер, алгоритм определяет точное положение контрольных точек в пространстве и отдаёт соответствующую команду.

Такой алгоритм поможет не только в работе с трёхмерными моделями, но может помочь распознать жесты языка глухонемых.

Таким образом, разработка Алексея Куракина стала ещё одним фактором, отодвигающим мышку в прошлое, после сенсорных экранов.

Источник: MPlast.by

__________________________________________________________________________________